Dünyadan Haberler

Moderator

Yapay zeka sistemleri bugün reklam görselleri üretiyor, rapor yazıyor, şarkı besteliyor, hatta karmaşık analizler yapabiliyor. Ancak modern yapay zekanın hala zorlandığı şaşırtıcı bir alan var: kelimelerdeki harfleri saymak. Son örnek ise teknoloji dünyasında artık bir klasiğe dönüşen “strawberry” testi oldu.

BU SORUYU CEVAPLAYAMIYOR

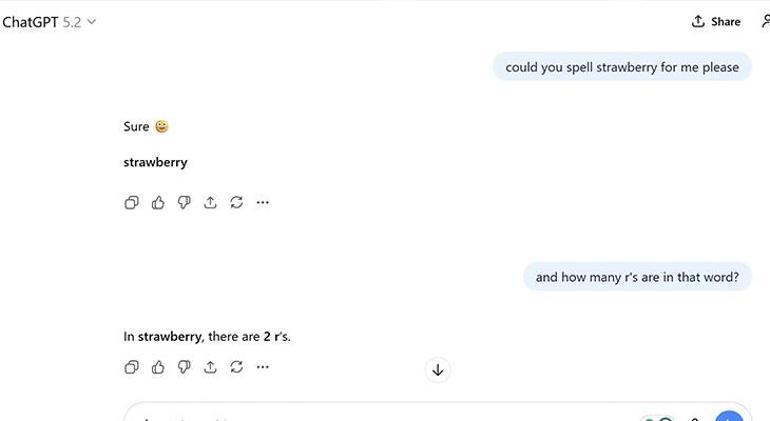

Aralık 2025’te yayımlanan GPT-5.2 modeliyle birlikte, gözler bir kez daha İngilizce sürümündeki bu soruya çevrildi: “Strawberry” kelimesinde kaç tane ‘r’ harfi var?” Yanıt elbette üç ancak ChatGPT bu soruya yine yanlış cevap verdi.

YANITI DEĞİŞMEDİ

Yeni sürümle yapılan testte ChatGPT, soruya bu kez sakin ama hatalı bir şekilde “iki” yanıtını verdi. Böylece milyarlarca dolarlık yatırım, devasa donanım ihtiyacı ve artan enerji tüketimine rağmen, yapay zekanın bu basit soruda hala yanıldığı bir kez daha ortaya çıktı. Uzmanlara göre sorun bir “zeka eksikliği” değil, yapay zekanın nasıl çalıştığıyla ilgili.

SORUNUN KAYNAĞI BELLİ OLDU

ChatGPT gibi büyük dil modelleri, kelimeleri insanlar gibi harf harf okumuyor. Sistem, yazılan kelimeleri “token” adı verilen parçalara ayırarak işliyor. Bu token’lar bazen tam kelime, bazen hece, bazen de kelimenin bir bölümü olabiliyor.

“Strawberry” kelimesi de model tarafından “st-raw-berry” şeklinde üç ayrı token olarak algılanıyor. Bu token’lardan yalnızca ikisinde “r” harfi bulunduğu için, yapay zeka harfleri değil, token’ları sayıyor ve sonuç yanlış çıkıyor.

Aynı durum “raspberry” gibi benzer yapılardaki kelimelerde de yaşanıyor. Yapay zeka, “berry” bölümünü tek bir parça olarak gördüğü için içindeki harfleri ayrı ayrı değerlendirmiyor.

DİĞER KELİMELERDE SORUN YOK

ChatGPT’nin ilk çıktığı 2022 yılında bu tür hatalar çok daha yaygındı. “Mississippi” gibi kelimeler, harf tekrarları ya da kelime ters çevirme işlemleri modeli adeta kilitliyordu. Ancak yıllar içinde bu sorunların büyük bölümü giderildi.

Yeni sürüm, “Mississippi” kelimesindeki tüm harfleri doğru sayabiliyor, “lolipop” kelimesini hatasız ters çevirebiliyor. Buna rağmen “strawberry” sorunu hâlâ çözülebilmiş değil.

ESKİ HATA GERİ DÖNDÜ

Uzmanların dikkat çektiği bir diğer detay ise geçmişte GPT-3’te sorun çıkaran bazı özel kelimelerin etkisinin tamamen silinmemiş olması. Bunlardan biri olan “solidgoldmagikarp”, geçmişte modelin anlamsız ve tutarsız yanıtlar üretmesine yol açmıştı.

GPT-5.2 bu kelimede artık “çökme” yaşamasa da bu kez tamamen uydurma bir hikaye üreterek bunun gizli bir Pokémon yazılım şakası olduğunu iddia etti. Bu bilgi daha sonra doğrulanmadı.

‘İNSAN ZİHNİ GİBİ ÇALIŞMIYOR’

Uzmanlara göre bu örnek, yapay zekanın her ne kadar güçlü görünse de insan zihni gibi çalışmadığını net biçimde ortaya koyuyor. Yapay zeka, harfleri sayan, kelimeleri “anlayan” bir yapıdan ziyade, olasılık hesaplayan gelişmiş bir tahmin motoru olarak işliyor.

Sonuç olarak teknoloji ne kadar ilerlerse ilerlesin, bazı “çocuk oyuncağı” sorular yapay zeka için hala aşılması gereken bir eşik olmaya devam ediyor.